Nie jedyne tego typu ostrzeżenie

Pod koniec marca, miliarder Elon Musk i współtwórca firmy Apple Steve Wozniak dołączyli do ponad tysiąca innych osób jako sygnatariusze listu otwartego, który wzywał do natychmiastowego wstrzymania prac nad systemami sztucznej inteligencji (AI) typu ChatGPT. List ten, opublikowany na platformie Future of Life Institute, współfinansowanej przez Muska, był reakcją na wprowadzenie przez firmę OpenAI nowego modelu języka GPT-4, bardziej zaawansowanej wersji narzędzia używanego przez ChatGPT, bota odpowiedzialnego za udzielanie odpowiedzi na pytania, prowadzenie rozmów i tworzenie tekstów na zamówienie. W liście zatytułowanym "Pause Giant AI Experiments" autorzy apelowali o wstrzymanie na co najmniej pół roku treningu systemów o większej mocy niż GPT-4. Ich zdaniem, systemy sztucznej inteligencji zdolne do rywalizacji z ludźmi mogą stanowić poważne zagrożenie dla ludzkości i społeczeństwa, a także wpływać na naszą historię. Dlatego prace nad nimi powinny być odpowiednio planowane i prowadzone przy zachowaniu należytej ostrożności.

Wystąpienie Sama Altmana w Senacie USA

W majowym wystąpieniu przed Senatem USA, Sam Altman, wezwał do utworzenia nowej agencji regulacyjnej w USA, która miałaby nadzorować sztuczną inteligencję. Altman podkreślił potrzebę skonstruowania odpowiednich ram prawnych i regulacyjnych, aby zapewnić odpowiedzialne i bezpieczne wykorzystanie AI. Jego apel odzwierciedla obawy związane z potencjalnymi negatywnymi skutkami AI i potrzebę skoordynowanego działania na rzecz bezpieczeństwa AI. AI Act w Unii Europejskiej

W odpowiedzi na rosnące znaczenie sztucznej inteligencji, Unia Europejska wprowadziła AI Act - akt prawny określający zobowiązania prawne dla sztucznej inteligencji. Akt ten zawiera precyzyjne wymogi dotyczące weryfikacji bezpieczeństwa, tworzenia wielojęzycznych systemów AI, ograniczeń w wykorzystywaniu danych, ochrony praw człowieka i tworzenia strategii bezpieczeństwa. Celem tych regulacji jest zapewnienie, że systemy sztucznej inteligencji będą wykorzystywane w sposób odpowiedzialny i godny zaufania. Unia Europejska rozważa również wprowadzenie odpowiedzialności za sztuczną inteligencję, aby chronić osoby dotknięte negatywnymi skutkami tej technologii. Wyścig technologiczny potencjalnym zagrożeniem dla społeczeństwa

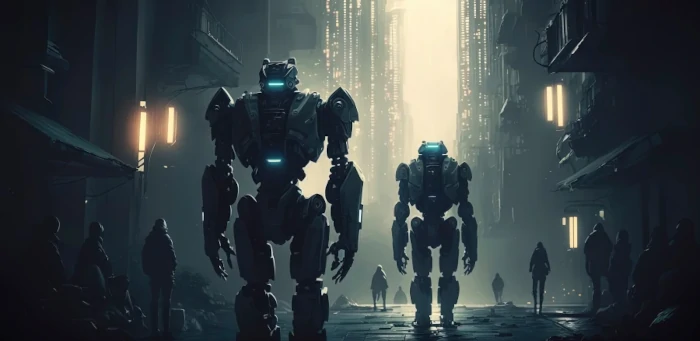

Liderzy polityczni dostrzegają strategiczną przewagę w posiadaniu najinteligentniejszych i najpotężniejszych systemów sztucznej inteligencji. Firmy zajmujące się systemami AI uczestniczą w wyścigu, w którym dążą do tworzenia coraz potężniejszych narzędzi, których działania nikt, włącznie z samymi twórcami, nie jest w pełni w stanie zrozumieć, przewidzieć i kontrolować. W przypadku sztucznej inteligencji ukierunkowanej na zdobycie władzy, istnieje szczególne niebezpieczeństwo, zwłaszcza jeśli jej wartości nie są zgodne z ludzkimi. Zachowania dążące do władzy mogą skłaniać systemy do udawania równości, układów z innymi AI, a nawet unikania nadzoru i kontroli. Właśnie dlatego tworzenie maszyn, które są potężniejsze od nas samych, może być niebezpieczne.

Podsumowanie

Twórcy sztucznej inteligencji wyrazili swoje obawy dotyczące szybkiego tempa rozwoju AI i potencjalnych skutków ubocznych, które mogą wpłynąć na naszą przyszłość. Dlatego apelują do rządów i innych organizacji, aby podjęły odpowiednie kroki w celu zwiększenia bezpieczeństwa związanego z rozwojem i zastosowaniem sztucznej inteligencji. Niektórzy eksperci sugerują, że rozwijająca się sztuczna inteligencja może stać się nieprzewidywalna i stanowić zagrożenie dla przyszłych generacji. Dlatego tak ważne jest, abyśmy zapewnili, że sztuczna inteligencja będzie rozwijana zgodnie z etycznymi i humanitarnymi standardami, a jej zastosowania będą spełniały najwyższe normy bezpieczeństwa. Aby ograniczyć ryzyko związane z rozwojem i zastosowaniem sztucznej inteligencji, potrzebujemy również kontroli nad firmami, które rozwijają tę technologię. Ważne jest, aby rządy wraz ze społecznością AI monitorowały sytuację i wprowadzały na bieżąco regulacje, które pomogą zwiększyć bezpieczeństwo sztucznej inteligencji. Nie powinniśmy bagatelizować zagrożeń, jakie niesie ze sobą rozwój SI. Ostrzeżenia i apele twórców AI powinny być traktowane poważnie. Dzięki temu możemy zmniejszyć ryzyko, jakie te technologie niosą dla naszej przyszłości. Zwiększenie bezpieczeństwa związane z rozwojem i zastosowaniem sztucznej inteligencji wymaga jednak podjęcia natychmiastowych działań przez rządy, środowiska związane z AI i całe społeczeństwo.